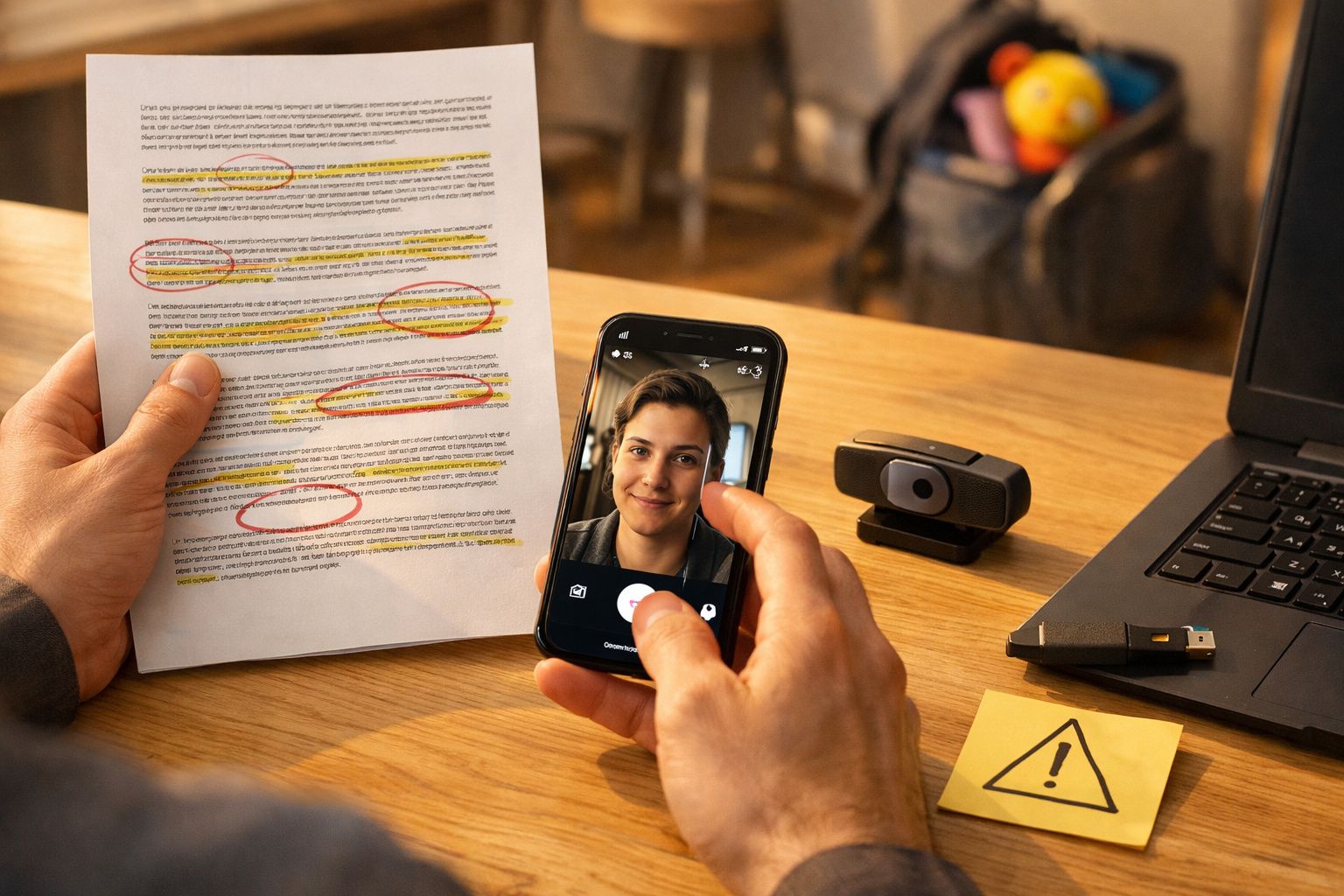

Alguém ergueu um telemóvel, a chiar que aquilo te podia transformar numa estrela de cinema com um simples toque. Apareceu uma fila de caras, luminosas e estranhamente artificiais, como se tivessem sido alisadas a ferro. As pessoas riam, comparavam fotos de antes e depois, a deslizar para aquele lugar leve e meio parvo em que a tecnologia parece pura magia.

Na ponta da secretária, o engenheiro de segurança nem levantou o olhar. Só abanou a cabeça - um gesto curto que dizia tudo. Não era rabujento. Nem se achava acima. Estava apenas cansado de um jeito muito específico. Demorei um minuto a notar a fissura silenciosa na sala - e foi aí que comecei a perguntar-me porque é que quem melhor entende tecnologia quase nunca usa as apps com IA de que o resto de nós adora gabar-se.

O dia em que a app de selfies chegou ao escritório

O Sam, o engenheiro, escrevia sem olhar para o ecrã, um hábito que fazia o teclado soar como chuva num telhado de zinco. Ainda assim, alguém lhe acenou com a app mesmo à frente. “É só para brincar, e é de graça”, disseram. Ele sorriu, respondeu que não tinha o telemóvel com ele e voltou ao terminal. “Grátis”, naquela sala, caiu com o peso de uma piada interna.

No comboio para casa, experimentei a app eu também, porque a curiosidade costuma ganhar. Era brilhante e um pouco inquietante. Os filtros sabiam exatamente como me favorecer - e exatamente quanto tempo me prender antes de pedir acesso ao rolo da câmara. Apaguei a app antes de o café arrefecer. Todos já tivemos aquele instante em que um brinquedo novo começa a parecer um negócio com letras minúsculas.

O que os profissionais veem quando leem uma política de privacidade

O resto de nós vê confettis e botões de partilhar. Os especialistas veem um contrato capaz de esvaziar uma vida. Leem “usamos os seus dados para melhorar serviços” e traduzem para “a sua cara, voz e palavras viram material de treino”. Leem “parceiros” e imaginam um desfile discreto de empresas de analítica, redes de publicidade e fornecedores de cloud a sugar metadados como se fossem ar. Quando aprendes a língua, é difícil deixar de a enxergar.

Uma vez, o Sam mostrou-me a distância entre palavras bonitas e o que elas fazem no mundo real. “Podemos recolher conteúdo que cria” muitas vezes inclui rascunhos que nunca guardaste. “Guardamos os dados pelo tempo necessário” pode esticar-se por anos, porque “necessário” é elástico. E aquela linha de “interesse legítimo” que parece tão educada? É uma cunha jurídica para manter a porta aberta.

A frase que decide tudo

Quase sempre existe uma frase única que decide se um especialista instala uma app. É a cláusula que permite partilhar dados com terceiros para “investigação”, “analítica” ou “melhoria do modelo”. As apps que dizem que não, que processam no próprio dispositivo, que minimizam de verdade - essas são raras. As outras são máquinas de venda automática em que tu és o produto na ranhura.

O problema das permissões: microfone, câmara, teclado

As apps de IA mais engenhosas precisam de sentidos para fazerem os seus truques. Câmara para filtros e tradução. Microfone para assistência por voz e notas de reuniões. Teclado para magia preditiva. Faz sentido, até perguntares o que acontece ao fluxo depois de o truque estar concluído.

Pergunta a alguém de segurança e vão falar-te de chamadas de rede em segundo plano que não param quando a app já nem está no ecrã. Algumas apps ouvem palavras de ativação e enviam pequenos excertos de áudio para a cloud para “melhorar a precisão”. Outras leem os nomes dos teus contactos para desenhar um mapa privado da tua vida social. Apps de teclado podem capturar tudo o que passa por elas - incluindo aqueles seis dígitos que escreveste quando pensavas que ninguém estava a ver.

O teu rosto, a tua voz, a tua escrita - dados de treino perfeitos

A IA precisa de exemplos como um chef precisa de ingredientes. Rostos, vozes, sotaques, estilos de escrita, até os erros de digitação estranhos que fazem de ti quem és. É assim que um modelo melhora a adivinhar o que vem a seguir. Por isso, quando uma app diz que vai “usar o seu conteúdo para melhorar os nossos algoritmos”, está a descrever uma estrada de sentido único: da tua realidade para o gráfico de crescimento deles.

Os especialistas não adoram ser formadores não remunerados. Já viram empresas dizerem “anonimizado” e depois voltarem a coser perfis com pedaços soltos suficientes. Uma app de selfies guardava “templates faciais” em vetores, porque vetores não parecem fotografias. Outra prometia eliminação, mas o suporte avisou que as cópias de segurança podiam demorar meses a rodar. Algumas apps são frontais sobre isto. Muitas não são.

Os rastreadores dentro das ferramentas

A maioria das apps de IA não é construída como pequenas casas com uma porta e uma janela. São prédios de apartamentos com corredores onde não podes entrar, cheios de SDKs - kits de software de motores de voz, empresas de analítica e parceiros de publicidade. Descarregas uma app, levas cinco. Cada uma com os seus hábitos de privacidade. Cada uma com fome.

Uma vez vi um registo de rede enquanto alguém usava uma ferramenta “gratuita” de transcrição por IA. O ecrã encheu-se de endereços que não reconheces, pequenos apertos de mão a acontecerem em segundo plano. Não era só fala-para-texto. Era replay de sessão, heatmapping e relatórios de falhas - palavras inocentes que, mesmo assim, podem entornar o teu contexto. Se alguma vez te sentiste um pouco perseguido pela internet, provavelmente estavas.

Peças pequenas, exposição grande

A cadeia de fornecimento é por onde os problemas se infiltram. Uma app de teclado pode jurar que não guarda as tuas mensagens e, ainda assim, incluir uma biblioteca de terceiros que o faz. Uma ferramenta de chat pode manter os teus prompts localmente, enquanto a sua biblioteca de analítica lê IDs do dispositivo e localização. E quando uma empresa é vendida, se funde ou muda de rumo, os dados mudam de dono enquanto tu ainda estás a beber chá. É por isto que os especialistas não apostam, a menos que consigam ver o baralho inteiro.

O mito da IA anónima

“Anonimizamos os seus dados” soa como uma manta quentinha. Os especialistas sabem que é uma cortina de renda num dia de vento. A ideia é simples: tirar nomes, desfocar detalhes, chamar-lhe seguro. Mas datas, lugares, tiques de escrita e grafos sociais juntam-se como peças de puzzle. Reidentificação não é rara. É um passatempo para estudantes de pós-graduação e um negócio para corretores.

Um investigador de privacidade explicou-me uma vez assim: se alguém grita num pub cheio, podes não ver a cara, mas ainda assim consegues perceber quem é pela gargalhada, pela história, pelo timing. Os dados são assim. O estilo é uma impressão digital. E o estilo é precisamente o que a IA quer aprender. Tu és o conjunto de dados.

“Personalização” que sabe demasiado

As apps de IA vendem calor humano. O assistente que soa como um amigo. O feed que adivinha as piadas de que vais gostar às 2 da manhã. A ferramenta de escrita que termina as tuas frases e pede desculpa quando falha. Parece íntimo até te lembrares de que intimidade exige esquecer de propósito - e as apps não esquecem a menos que as forces.

É aí que a coisa derrapa. A personalização vive de profiling: ritmos de localização, digitação madrugada fora, pesquisas sazonais que dizem mais do que o teu estado civil alguma vez diria. Dados que antes moravam dentro da tua cabeça são subcontratados para servidores onde rendem. A história que contas a uma app pode reaparecer como anúncio noutra. E depois o teu telemóvel vibra com uma recomendação que acerta na coisa que ainda nem disseste em voz alta.

As crianças em segundo plano

Não falamos disto o suficiente. Muitas apps de câmara e voz com IA aprendem com pessoas que nunca consentiram - como a criança que entrou no enquadramento ou o amigo que resmungou na cozinha. O modelo não sabe a quem pertence o consentimento. Só vê píxeis e forma de onda. Junta-os ao seu banco de memória e segue.

Pais que trabalham em tecnologia muitas vezes traçam uma linha dura. Nada de brinquedos com IA que “telefonam para casa”. Nada de microfones “para melhorar a leitura do seu filho” que guardam as gravações. Não é medo. É o conhecimento calmo de que dados recolhidos agora podem durar mais do que a infância. Uma futura universidade, empregador ou seguradora não vai precisar de conspiração para saber demasiado - só de boa pesquisa.

A fantasia da eliminação

Todas as apps prometem um botão de apagar. Parece responsável, e às vezes é. As melhores fazem poda pelo caminho, mantêm dados no dispositivo e deixam-te recomeçar com um toque. Muitas não. Enfileiram eliminações, guardam backups, baralham cópias entre regiões enquanto a poeira assenta em servidores que nunca vais ver.

Já fiz pedidos de dados e vi empresas a contorcerem-se. Muitas vezes nem elas sabem onde vivem todas as cópias - o que é, talvez, a resposta mais honesta. Os logs existem para tornar sistemas estáveis, e os logs têm memória. Isso não é mau por si só. Só transforma a promessa de apagamento total numa história para adormecer que os adultos contam uns aos outros para conseguirem dormir.

“Mas eu preciso destas ferramentas para o trabalho”

Eu também. O truque está em escolher. Os especialistas procuram processamento no dispositivo, caches locais, planos pagos que desligam a “melhoria do modelo” e fornecedores que publicam auditorias de segurança sem dramatismo. Confirmam se a empresa ganha dinheiro com subscrições ou se vende “insights” em volume. Negócio diferente, incentivos diferentes.

Também separam identidades. O trabalho fica num dispositivo gerido com perfis apertados. A vida pessoal vive num telemóvel com poucas apps e ainda menos permissões. E quando testam algo mais arriscado, usam uma conta isco, como quem usa luvas de forno. Não porque sejam paranoicos. Porque dedos queimados doem.

Sinais de alerta que se sentem

Não precisas de ser engenheiro para perceber quando uma app quer demais. O pop-up que pede contactos antes de te mostrar seja o que for. A definição que volta a “partilhar” depois de cada atualização. Os emails animados a dizer “atualizámos a nossa promessa de privacidade” e depois a acrescentarem discretamente um novo parceiro que nem consegues pronunciar. O teu instinto é um sensor. Deixa-o apitar.

Também há sinais verdes. Páginas de privacidade curtas, com palavras simples. Atualizações que se gabam de recolher menos, não mais. Um painel onde podes ver e apagar dados de treino sem implorar ao suporte. E a rara empresa que diz não a investidores que a pressionam a “monetizar” a base de utilizadores. Essa palavra pertence a folhas de cálculo, não a pessoas.

O que os especialistas em tecnologia fazem em vez disso

Usam apps de câmara que não fazem upload a menos que sejam instruídas. Notas de voz que ficam no dispositivo. Navegadores que bloqueiam cookies de terceiros e removem rastreadores dos links como cotão de um casaco. Para tradução, escolhem ferramentas que correm localmente. Para escrita, guardam rascunhos sensíveis offline e colam apenas fragmentos - não o diário inteiro. Parece picuinhas até se tornar hábito.

Também definem limites. Nada de assistentes de IA no quarto. Nada de microfones sempre ligados no quarto do bebé. Nada de “teclado da semana” por conveniência. E leem os dois primeiros ecrãs da política de privacidade como quem lê um menu, à procura das azeitonas que detestam. Sejamos honestos: ninguém faz isto todos os dias. Mas quando é uma ferramenta que vais alimentar com a tua voz, a tua cara, os teus planos privados, valem três minutos e uma sobrancelha levantada.

A verdade desconfortável sobre o “gratuito”

O gratuito faz-nos clicar como o estalar de dedos de um hipnotizador. É social. É brincalhão. Parece um presente do futuro. O custo aparece mais tarde, medido em anúncios que te encurralam, em modelos treinados com a tua semelhança, em contas de cloud que nunca vês mas pagas com a tua atenção. O gratuito é um reembolso que nunca vais receber.

Os especialistas não rejeitam a alegria. Rejeitam a fatura que chega anos depois. Preferem pagar uma vez, ter recibo e sair da loja com algo que lhes pertence. O resto de nós também pode fazer a sua versão disso. Paga com dinheiro quando puderes. Paga com menos dados quando não puderes.

Porque é que a recusa silenciosa importa

Cada vez que alguém como o Sam diz que não, não é snobismo. É um pequeno protesto a favor da atenção, da privacidade e do direito a esquecer. O “não” abranda a fome uma fração, deixa à míngua alguns treinos, empurra um gestor de produto a acrescentar um verdadeiro interruptor de desligar. Abre espaço para crescerem ferramentas melhores.

E por vezes muda uma sala. Naquele dia no escritório, as gargalhadas abrandaram. Algumas pessoas pousaram os telemóveis e olharam para as caras reais umas das outras. A chaleira fez clique na cozinha, um som pequeno e caseiro. Alguém perguntou: “Então qual é que usas?” A conversa virou - não contra a IA, mas na direção dela, com olhos mais claros e um telemóvel mais leve.

Uma regra simples que podes guardar

Se precisa da tua câmara, microfone ou teclado, decide se sussurrarias os mesmos segredos num elevador cheio. Se não, então não. Se a app quer tudo logo ao início, afasta-te. Se parece polida demais para algo que não custa nada, pergunta o que mais está a vender.

E quando uma app te dá dignidade - escolha, controlo, eliminação a sério - recompensa-a. Diz aos teus amigos. Carrega no botão de pagar se puderes. O futuro que recebemos é aquele que alimentamos. A privacidade não é um interruptor. É uma prática, como trancar a porta à noite e ainda assim abri-la a pessoas em quem confias.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário